Une vaste enquête mondiale révèle les règles éthiques que devraient suivre les véhicules autonomes en situation d’accident sont très variables d’un pays à l’autre

Par |

Lorsqu’un conducteur appuie sur les freins pour éviter de heurter un piéton qui traverse la route, il prend sans s’en rendre compte une décision morale qui transfère le risque du piéton aux passagers de la voiture : vaut-il mieux renverser le piéton ou risquer de blesser les passagers ? Les voitures autonomes devront bientôt porter elles-mêmes de tels jugements éthiques – encodés dans leur logiciel de bord. Mais quel code moral doit-on implémenter dans les véhicules autonomes ? Une vaste enquête menée auprès de 2,3 millions de personnes dans le monde suggère qu’il pourrait être difficile de s’entendre sur un code éthique universel en la matière…

Lorsqu’un conducteur appuie sur les freins pour éviter de heurter un piéton qui traverse la route, il prend sans s’en rendre compte une décision morale qui transfère le risque du piéton aux passagers de la voiture : vaut-il mieux renverser le piéton ou risquer de blesser les passagers ? Les voitures autonomes devront bientôt porter elles-mêmes de tels jugements éthiques – encodés dans leur logiciel de bord. Mais quel code moral doit-on implémenter dans les véhicules autonomes ? Une vaste enquête menée auprès de 2,3 millions de personnes dans le monde suggère qu’il pourrait être difficile de s’entendre sur un code éthique universel en la matière…

La plus grande enquête jamais réalisée sur l’éthique des machines, publiée le 24 octobre dans la revue Nature, révèle que la plupart des principes moraux qui guident les décisions d’un conducteur varient selon les pays. Par exemple, dans un scénario où des piétons et des passagers mourraient dans une collision, les habitants des pays relativement prospères dotés d’institutions solides sont moins susceptibles d’épargner un piéton qui s’engage en tort sur la route.

« Les gens qui réfléchissent à l’éthique des machines partent du principe que l’on peut trouver un ensemble de règles parfait pour les robots. Mais ce que nous montrons avec ces données, c’est qu’il n’existe pas de règles universelles », explique Iyad Rahwan, informaticien à l’Institut de technologie du Massachusetts (MIT) et coauteur de l’étude.

L’enquête, appelée la « Machine morale », présentait 13 scénarios dans lesquels la mort d’une personne était inévitable. Les participants devaient choisir qui épargner dans des situations qui impliquaient différentes combinaisons de variables : jeunes ou vieux, riches ou pauvres, homme ou femme, nombre de personnes impliquées, etc.

Certes, les gens sont rarement confrontés à de tels dilemmes moraux, et certains commentateurs se demandent si les scénarios proposés dans le questionnaire sont pertinents par rapport aux questions éthiques qui se posent en pratique avec les voitures sans conducteur. Mais les auteurs de l’étude affirment que ces scénarios sont un bon modèle des décisions morales subtiles que les conducteurs prennent chaque jour. Ils soutiennent que les résultats révèlent des nuances culturelles que les gouvernements et que les constructeurs de voitures autonomes devraient prendre en compte s’ils veulent que ces véhicules soient acceptés par le public.

Au moins une entreprise qui travaille sur les voitures autonomes – le constructeur allemand Audi – estime que cette enquête pourrait contribuer à ouvrir un débat important sur ces questions (d’autres entreprises ayant des programmes de véhicules autonomes, dont le constructeur automobile Toyota et les sociétés technologiques Waymo et Uber, ont refusé de commenter les conclusions de l’enquête).

Nicholas Christakis, chercheur en sciences sociales à l’Université Yale de New Haven, dans le Connecticut, est pour sa part fasciné par ces résultats. « C’est un article remarquable », juge-t-il. La question de savoir si l’éthique est universelle ou si elle varie d’une culture à l’autre est un débat ancien, selon Christakis, et le « problème du XXIe siècle » qu’est la programmation des véhicules autonomes l’a revigoré.

La route sinueuse de la morale

Certaines des plus grandes entreprises technologiques du monde – dont Google, Uber et Tesla – et les constructeurs automobiles développent aujourd’hui des programmes de voiture autonome. Ces entreprises font valoir que ces véhicules pourraient améliorer la sécurité routière, faciliter la circulation et réduire la facture énergétique. Mais les chercheurs en sciences sociales avertissent que les voitures autonomes soulèvent des questions éthiques inédites et pourraient avoir des conséquences imprévues pour la sécurité publique et l’environnement.

En 2016, l’équipe de Iyad Rahwan s’est heurtée à un paradoxe éthique concernant les voitures autonomes : dans les enquêtes, les gens disaient qu’un véhicule autonome devait protéger les piétons même s’il fallait sacrifier les passagers, mais également qu’ils ne voudraient pas acheter de véhicules autonomes programmés pour agir ainsi.

Curieux de voir si la perspective de la conduite automatique soulevait d’autres questions éthiques, Rahwan a réuni une équipe internationale de psychologues, d’anthropologues et d’économistes pour créer l’enquête Machine morale. En 18 mois, le questionnaire en ligne avait récolté 40 millions de décisions prises par 2,3 millions de personnes dans 233 pays.

Quels enseignements se dégagent ? Premièrement, quel que soit leur âge, leur sexe ou leur pays, la plupart des gens préfèrent épargner les humains plutôt que les animaux de compagnie, et plutôt les groupes que les individus seuls. Ces réponses sont en accord avec les règles proposées dans ce qui pourrait devenir la seule directive gouvernementale sur la conduite autonome : un rapport publié en 2017 par la Commission d’éthique allemande sur la conduite automatique et connectée.

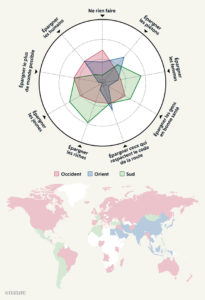

Mais l’accord s’arrête là. Lorsque les auteurs ont analysé les réponses provenant des 130 pays ayant comptabilisé au moins 100 participants, ils ont constaté que les pays pouvaient être divisés en trois groupes. L’un comprend l’Amérique du Nord et plusieurs nations européennes où le christianisme a historiquement été la religion dominante ; un autre groupe comprend des pays comme le Japon, l’Indonésie et le Pakistan, avec de fortes traditions confucéennes ou islamiques. Un troisième groupe comprend l’Amérique centrale et l’Amérique du Sud, ainsi, étrangement, que la France et les anciennes colonies françaises. Les participants des pays du premier groupe montrent par exemple une plus grande préférence pour sacrifier les personnes âgées et sauver les jeunes que ceux des pays du second groupe.

Une enquête regroupant 23 millions de personnes dans le monde entier révèle des disparités dans les principes moraux qui dictent les réactions des conducteurs. Les participants devaient décider qui ils préféraient sauver dans 13 scénarios où une collision inévitable entrainait la mort de différentes combinaisons de piétons et de passagers. L’analyse des réponses fait émerger trois groupes de pays possédant des préférences éthiques différentes.

Une enquête regroupant 23 millions de personnes dans le monde entier révèle des disparités dans les principes moraux qui dictent les réactions des conducteurs. Les participants devaient décider qui ils préféraient sauver dans 13 scénarios où une collision inévitable entrainait la mort de différentes combinaisons de piétons et de passagers. L’analyse des réponses fait émerger trois groupes de pays possédant des préférences éthiques différentes.© Nature

Les chercheurs ont également identifié des corrélations entre les indicateurs socio-économiques d’un pays et les opinions éthiques de ses habitants. Les individus originaires de pays dotés d’institutions gouvernementales fortes, comme la Finlande et le Japon, choisissent par exemple plus souvent de sacrifier les personnes qui traversent illégalement la route que les participants de pays dotés d’institutions plus faibles, comme le Nigeria ou le Pakistan.

Les scénarios qui forçaient les participants à choisir entre sauver un sans-abri d’un côté de la route ou un cadre supérieur de l’autre ont révélé un autre point de désaccord : les choix éthiques des individus sont souvent en corrélation avec le niveau d’inégalité économique dans leur culture. Les habitants de la Finlande – où l’écart entre les riches et les pauvres est relativement faible – n’ont pas montré de préférence pour une option ou l’autre. Mais le participant moyen de Colombie – un pays où les disparités économiques sont importantes – choisit de tuer la personne de statut social inférieur.

Azim Shariff, psychologue à l’Université de la Colombie-Britannique à Vancouver, trouve ce résultat intéressant parce qu’il suggère que l’enquête révèle vraiment les préférences morales des gens. « Si l’on suppose que les pays où les inégalités de revenus sont plus faibles ont des politiques qui favorisent l’égalitarisme, cela montre que les normes morales qui soutiennent ces politiques s’expriment dans la façon dont les gens répondent à ces dilemmes moraux ».

Quels risques sommes-nous prêts à prendre ?

Bien que les véhicules autonomes ne soient pas encore commercialisés, des versions d’essai circulent dans plusieurs villes américaines. D’ici 2021, au moins cinq constructeurs espèrent généraliser l’utilisation de voitures et de camions autonomes.

Bryant Walker Smith, professeur de droit à l’Université de Caroline du Sud en Colombie, est pourtant sceptique quant à l’utilité pratique de l’enquête Machine morale. Selon lui, l’étude est irréaliste parce que dans la vie réelle, un véhicule ne sera quasiment jamais confronté à un choix entre deux victimes potentielles. « Autant s’inquiéter de la façon dont les voitures intelligentes réagiront aux chutes d’astéroïdes », ironise-t-il.

Mais pour les auteurs de l’étude, leurs scénarios représentent bien des jugements moraux mineurs que les conducteurs humains font régulièrement – parfois avec des conséquences fatales. Un conducteur qui s’écarte d’un cycliste sur une route de montagne sinueuse accroît par exemple le risque de heurter un véhicule qui arriverait en sens inverse. Si le nombre de voitures sans conducteur augmente sur les routes, la probabilité qu’elles soient impliquées dans de tels accidents augmentera également.

Certains constructeurs automobiles sont à l’écoute. Barbara Wege, qui dirige un groupe spécialisé dans l’éthique des véhicules autonomes chez Audi à Ingolstadt, en Allemagne, affirme que de telles études sont précieuses. Elle pense que, proportionnellement, les voitures autonomes provoqueront moins d’accidents que les conducteurs humains, mais que les événements impliquant des machines attireront plus l’attention.

Des enquêtes telles que celle-ci peuvent contribuer à mettre à l’ordre du jour du débat public les inévitables conséquences de l’avènenement des voitures autonomes. « Nous devons trouver un consensus social sur les risques que nous sommes prêts à prendre. », dit Barbara Wege.

Ce texte est une traduction de l’article Self-driving car dilemmas reveal that moral choices are not universal, publié sur nature.com le 24 octobre 2018.